فجر اليوم//

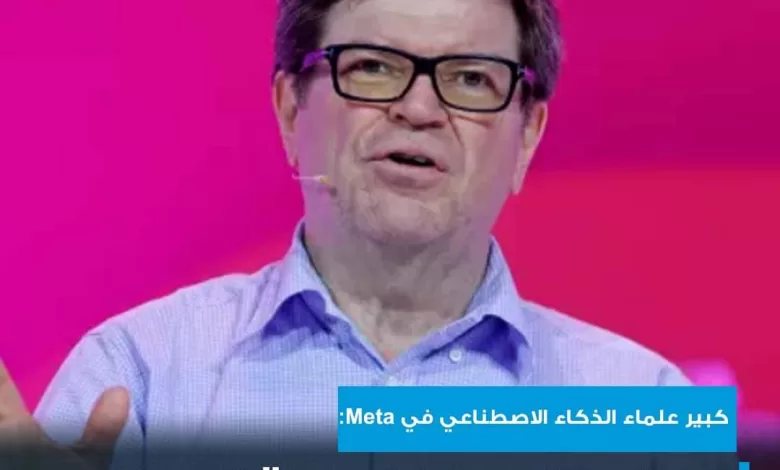

CNBC

قال كبير علماء الذكاء الاصطناعي في Meta يان ليكان إن أنظمة الذكاء الاصطناعي الحالية مثل ChatGPT لا تتمتع بذكاء بشري وهي بالكاد أكثر ذكاءً من الكلاب، جاءت تصريحاته مع احتدام الجدل حول مخاطر التكنولوجيا سريعة النمو.

يستند ChatGPT – الذي طورته شركة OpenAI – إلى ما يسمى بنموذج اللغة الكبير، هذا يعني أن نظام الذكاء الاصطناعي قد تم تدريبه على كميات هائلة من البيانات التي تتيح للمستخدم توجيه الأسئلة والطلبات إليه، بينما يرد روبوت الدردشة بلغة نفهمها.

أثار التطور السريع للذكاء الاصطناعي قلق كبار الخبراء من أن التكنولوجيا – إذا لم يتم التحقق منها – يمكن أن تشكل مخاطر على المجتمع. قال الرئيس التنفيذي لشركة Tesla إيلون ماسك هذا العام إن الذكاء الاصطناعي هو “أحد أكبر المخاطر على مستقبل الحضارة”.

في مؤتمر Viva Tech الأربعاء 14 يونيو/حزيران، سُئل ليكان عن القيود الحالية للذكاء الاصطناعي. ركز على الذكاء الاصطناعي التوليدي المدرب على نماذج اللغة الكبيرة ، قائلاً إنهم ليسوا أذكياء جدًا، لأنهم مدربون على اللغة فقط.

وقال: “لا تزال هذه الأنظمة محدودة للغاية، وليس لديها أي فهم للعالم الحقيقي، لأنهم مدربون فقط على كمية هائلة من النصوص”.

وأضاف ليكان: “معظم المعرفة البشرية لا علاقة لها باللغة.. لذلك لا يتم اكتساب هذا الجزء من التجربة الإنسانية بواسطة الذكاء الاصطناعي.”

وأشار ليكان إلى أن نظام الذكاء الاصطناعي يمكنه الآن اجتياز اختبار نقابة المحامين في الولايات المتحدة للعمل في المحاماة. ومع ذلك، قال إن الذكاء الاصطناعي لا يمكنه تحميل غسالة الصحون، في مهمة يمكن لطفل في عمر الـ 10 سنوات تعلمها في 10 دقائق.

وأوضح أن Meta تعمل حالياً على تدريب الذكاء الاصطناعي على مقاطع الفيديو، بدلاً من اللغة فقط ،وهي مهمة أصعب.